Google Geminiの透かしポリシーを理解する

透かしが実際に何であるかを知る

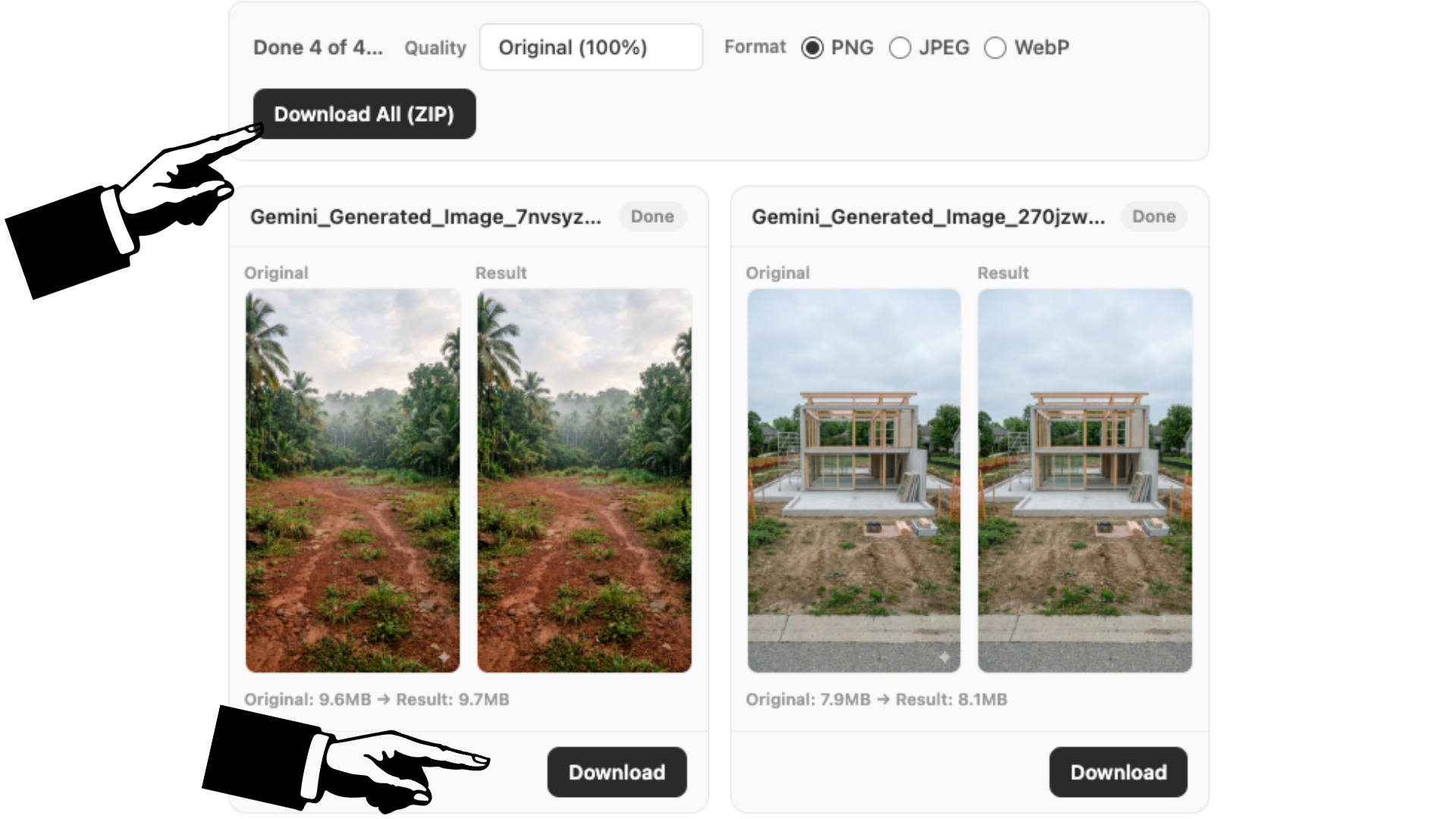

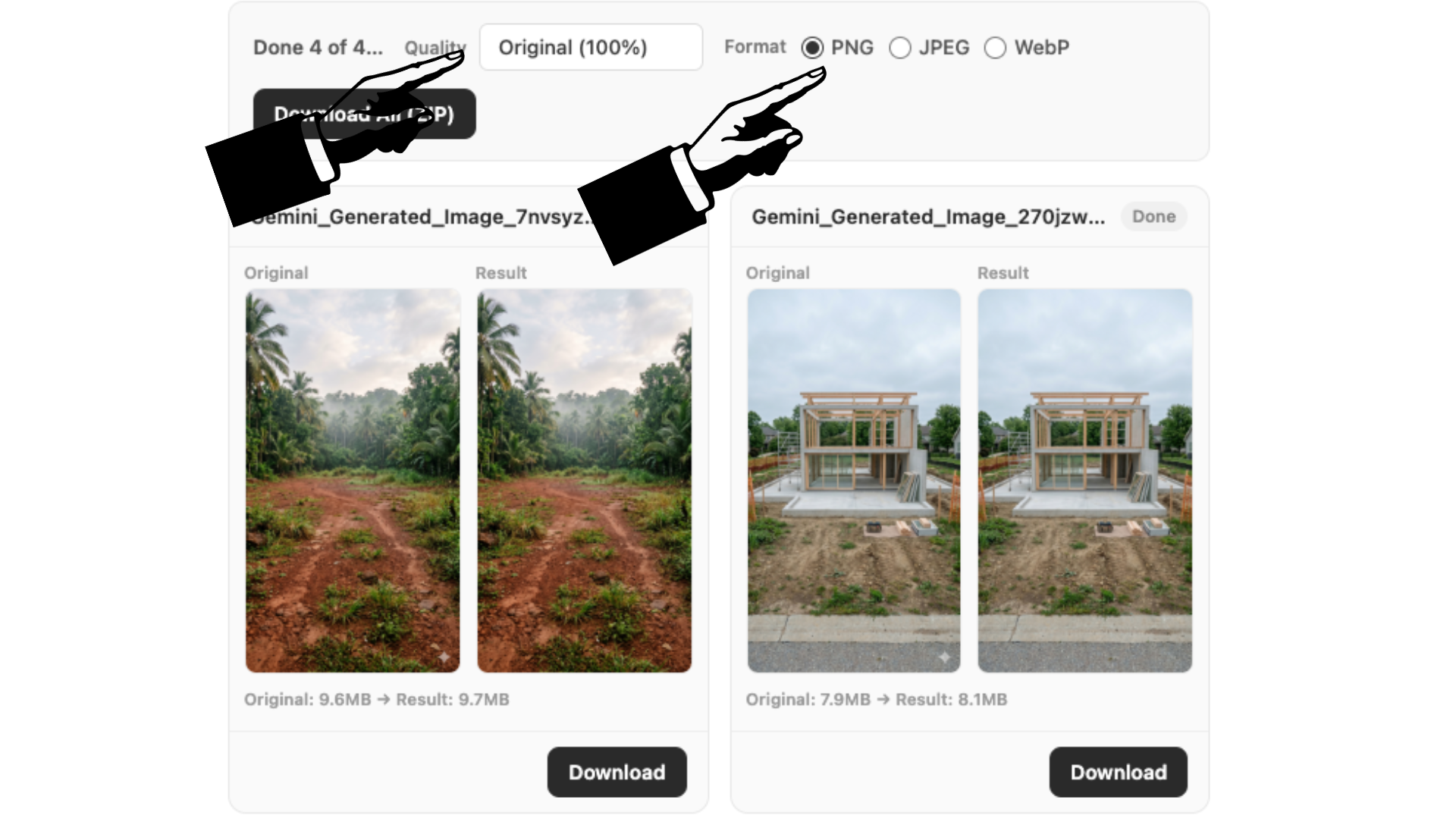

法的な質問に入る前に、何を扱っているのかを理解することが役立ちます。Geminiは生成するすべての画像に2種類の透かしを追加します:右下隅にある目に見える半透明のロゴと、SynthIDと呼ばれる目に見えないデジタル指紋です。目に見える方はほとんどの人が気づき、削除したいと思うものです。これは基本的にGoogleが「これはAIによって作成されました」と言う方法です。目に見えない方は画像データの奥深くに埋め込まれており、編集、スクリーンショット、形式変換を経ても残ります。当ツールは目に見えるロゴのみを扱います。

透かし削除に関するGoogleの立場

Googleは「Geminiの透かしを削除してはならない」と明記した特定のポリシー文書を公開していません。利用規約は、有害なコンテンツの生成、著作権侵害、他者へのなりすましなど、AIツール自体の悪用をしないことにより重点を置いています。とはいえ、Googleが透かしを追加したのには明確な理由があります:透明性です。もしあなたが意図的に人々を欺くために透かしを削除しているなら—例えば、AIアートを自分の手描き作品として偽ったり、誤解を招く画像を作成したり—細則に何が書かれていようと、倫理的に問題のある領域に足を踏み入れていることになります。

情報に基づいた決定を下す

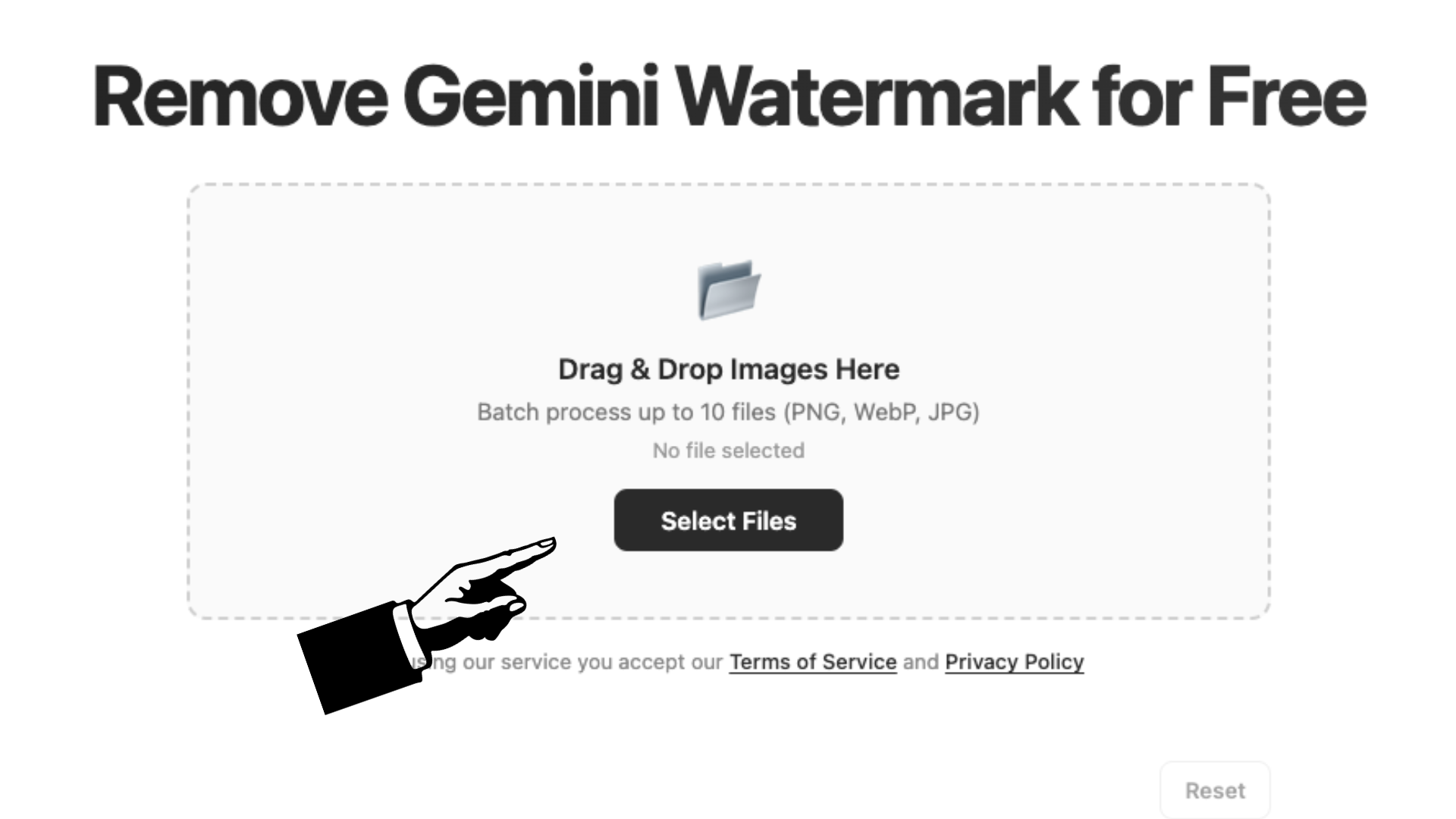

結局のところ、透かしを削除するかどうかは文脈次第です。家族のスライドショーのために個人写真をきれいにしていますか?それは、オリジナルアートとして販売するために画像から透かしを剥がすのとは全く別物です。当ツールを使用するほとんどの人はその中間にいます—クライアントワークにAIビジュアルを組み込むデザイナー、SNS用に画像を磨くコンテンツクリエイター、プレゼン資料を準備する専門家など。ユースケースが何であれ、重要な場面でAIの関与について率直であることが最善の方針です。ツールはきれいな画像を提供します。オーディエンスに正直であることはあなた次第です。